Sztuczna inteligencja z Nanyang Technological University w Singapurze potrafi czytać z ludzkich dłoni

Czujniki, które dotychczas wspierały systemy robotyczne w rozpoznawaniu ludzkich gestów, wkrótce odejdą do lamusa. Naukowcy z Singapuru stworzyli bowiem niewidoczny dla kamery, rozciągliwy sensor, który ściśle przylega do dłoni – a potem podłączyli go do sieci neuronowych, by nauczył się idealnie odwzorować to, jak dłońmi poruszamy. Systemy rozpoznające ludzkie gesty, wykorzystywane np. w rozrywce, medycynie czy zdalnym sterowaniu urządzeniami i robotami, osiągnęły nieznaną do tej pory precyzję.

Jeśli robot ma skutecznie odwzorować pracę człowieka – czy to stukanie młotkiem, czy precyzyjne cięcie skalpelem – musi się tego nauczyć bezpośrednio, naśladując ludzkie gesty. Rozpoznawanie gestów ludzkich rąk przez systemy SI znalazło w minionej dekadzie zastosowanie w superprecyzyjnych robotach chirurgicznych, sprzęcie do monitorowania zdrowia czy choćby grach komputerowych. Początkowo służące do tego systemy wyposażano wyłącznie w kamery. Później pozyskiwaniu danych służyły specjalne czujniki do noszenia na ciele, na swój sposób odtwarzające zdolność czucia właściwą dla skóry. To tzw. systemy somatosensoryczne, czyli odczuwające bodźce.

Problem w tym, że precyzja działania większości tradycyjnych czujników była niezadowalająca, a na dodatek trzeba je było przytwierdzać do dłoni lub innych części ciała za pomocą uchwytów lub joysticków. Urządzenia te były zbyt duże i słabo połączone ze skórą użytkownika. Na dodatek dane z kamer i czujników sensorycznych trzeba było łączyć, a takie przetwarzanie było nieefektywne i zabierało dużo czasu. W przypadku urządzeń medycznych wiązało się to z dodatkowym ryzykiem dla zdrowia czy życia pacjenta.

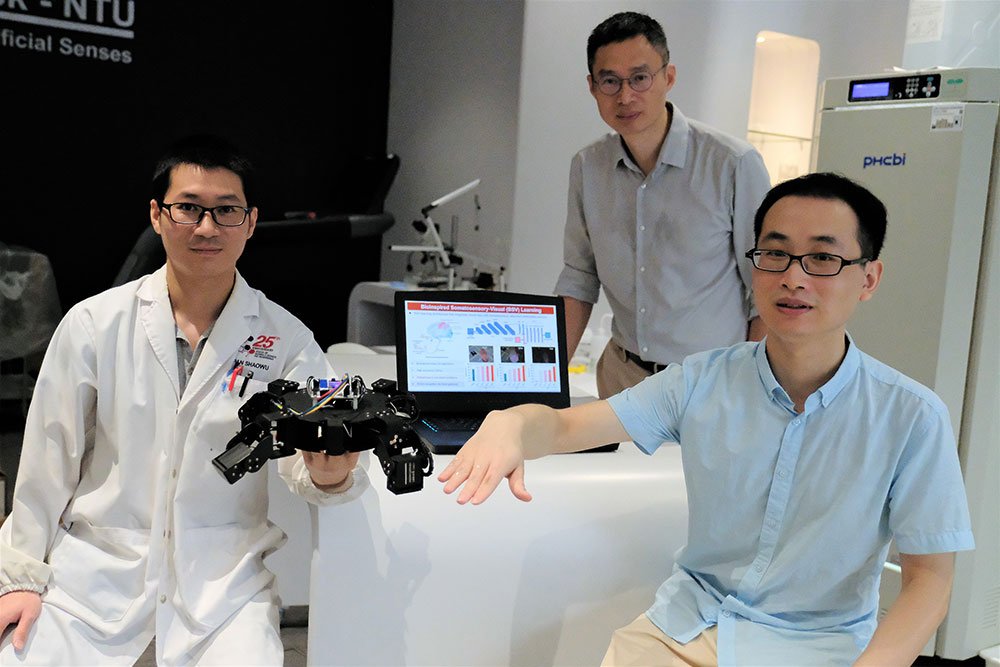

Naukowcy z NTU stworzyli więc system oparty na połączeniu wizji komputerowej oraz odczuć sensorycznych, wiernie imitujący procesy, które zachodzą w ludzkim mózgu. Rozciągliwe czujniki z nanowłókien węglowych są w stanie dostarczyć mnóstwa danych wysokiej jakości. Sieć takich czujników, przypominająca skórę lub gumę, naciągana jest na dłoń i ściśle do niej przylega. System rejestruje dane za pomocą sztucznej inteligencji i przetwarza je na obraz.

– Nasze rozwiązanie wykorzystuje rozciągliwe czujniki naprężenia, które wygodnie mocuje się na ludzkiej skórze. Pozwala to na pozyskiwanie wysokiej jakości sygnału, niezbędne do precyzyjnego rozpoznawania gestów – zaznacza profesor Chen Xiaodong ze Szkoły Inżynierii Materiałowej na NTU, główny autor badań.

Systemy rozpoznające ludzkie gesty, wykorzystywane w rozrywce, medycynie czy zdalnym sterowaniu urządzeniami i robotami, osiągnęły nieznaną do tej pory precyzję

Spośród trzech wykorzystanych w przedsięwzięciu sieci neuronowych jedna do służy do wczesnego przetwarzania wizualnego, druga – do wczesnego przetwarzania danych somatosensorycznych, natomiast trzecia łączy informacje wizualne i dotykowe. Nowa „cyfrowa skóra” ma spowodować postęp w medycynie, grach, sterowaniu urządzeniami, technice konstruowania egzoszkieletów i wielu innych dziedzinach. O tym, że nadzieje te są uzasadnione, zdaje się świadczyć eksperyment z udziałem robota wyposażonego w system. Maszyna już za pierwszym razem przeszła przez specjalnie do tego celu skonstruowany labirynt (roboty wyposażane tylko w systemy wizualne popełniały wiele błędów).

Nowy system sprawdza się także w trudnych warunkach, m.in. w hałasie i przy słabym oświetleniu, a w pełnej ciemności rozpoznaje obiekty z niemal 97-procentową dokładnością – chwalą się eksperci z Singapuru.